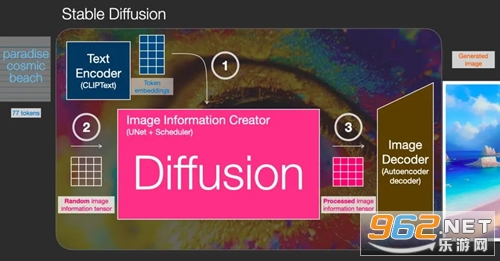

��stable diffusion����2022�귢�������ѧϰ���ֵ�ͼ������ģ�͡�����Ҫ���ڸ������ֵ�����������ϸͼ���ܹ��ڼ������ڴ��������˾�̾��������Ʒ�����������շѵģ�ÿ���û���Լֻ������200��ͼƬ���������֮����Ҫ��ֵ����ʹ�á�

stable diffusion�ֻ������أ��������

stable diffusion������ַ���������

stable diffusion��װʹ�ý̳�

һ��ǰ�Խ���

Ŀǰ�����ϱȽ�Ȩ�����������ڹ����е�AI�滭������ʵ�����һ����Midjourney�����ļ��MJ������һ����stable-diffusion�����ļ��SD����

MJĿǰ����ѣ���Ҫʹ�ñ����ֵ��һ����10��Ԫ����ͨ��������AI�滭���������㡣��SD��Դ��ѣ����������Ѷȸߣ�ѧϰ�ɱ�����һ����װ�����ѵ�һ��Ƭ�ˡ����ҷdz��Ե������ã��Կ����ڴ棩��

����ܽ����װ���⡢ѧϰ���⡢�������ܣ�������������֣�SD�Ŀ��������̫���ˣ���ֱ�ӵ��ŵ㣺���û�Ǯ��������������😆��

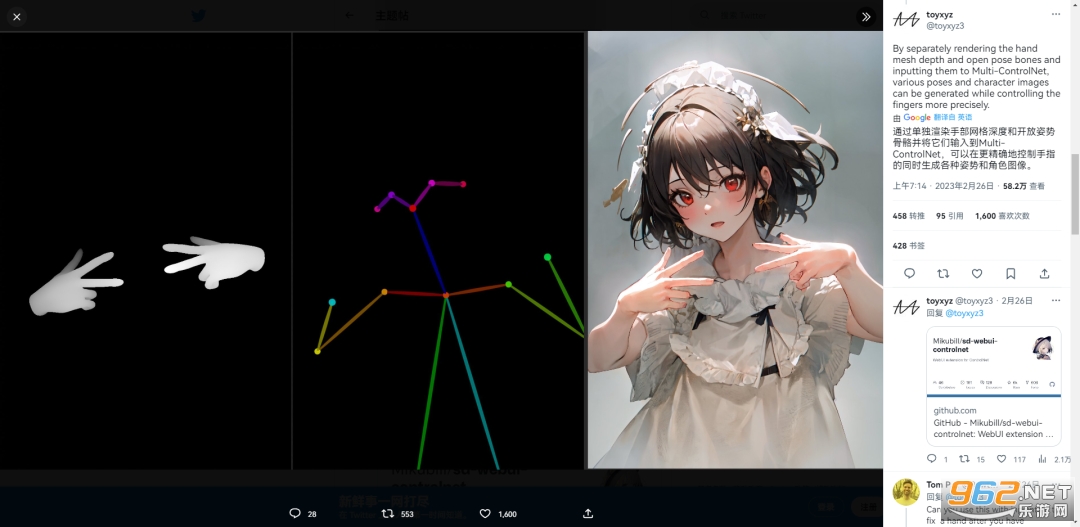

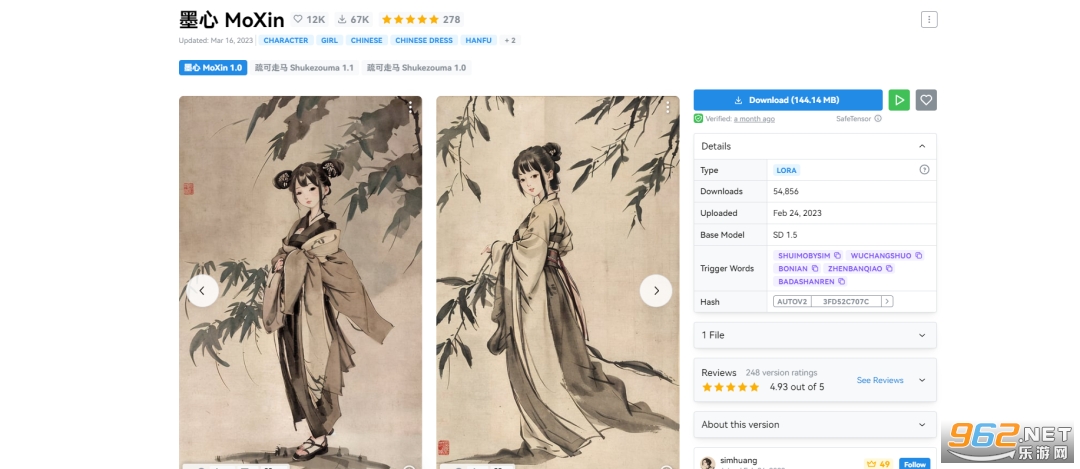

���ڿ�Դ���ԣ�SD �кܶ���Ѹ����������Ԥѵ��ģ�ͣ�fine-tune���Ͳ�������������ȡ�����������������ƹǼܡ����������Ϣ����������ָ�IJ�� Controlnet��ʹ���������������ڻ滭�����о���������Ķ������ơ����ƺͻ��湹ͼ��ϸ��

��� Mov2Mov ���Խ�������Ƶ���з��ת����SD ��ӵ�� Inpainting �� Outpainting ���ܣ����Զ�ͼ��������ֲܾ��ĺ����ӣ���Щ����Ŀǰ Midjourney �������ġ�

��������@Toyxyz3 ͨ���ֱ���Ⱦ�ֲ�������ȺͿ������ƹ����ķ�ʽ���� SD ��ʵ�ֶ�������ָ�����Ƶľ�����

��������SD LORA ���� Dreambooth ���Լ�ϲ�����������������ѵ������ģ�ͣ������Լ���ר�� AI �滭���ߣ�Ҳ�л�ʦ�����ʦ���Լ���ԭ����Ʒѵ��ģ�ͣ�֮��������˾�֮�������������������� SD ���Լ����ٳ����ָ����ͼ��

SD��Դ��ַ

https://github.com/Stability-AI/stablediffusion

��������Ҫ��

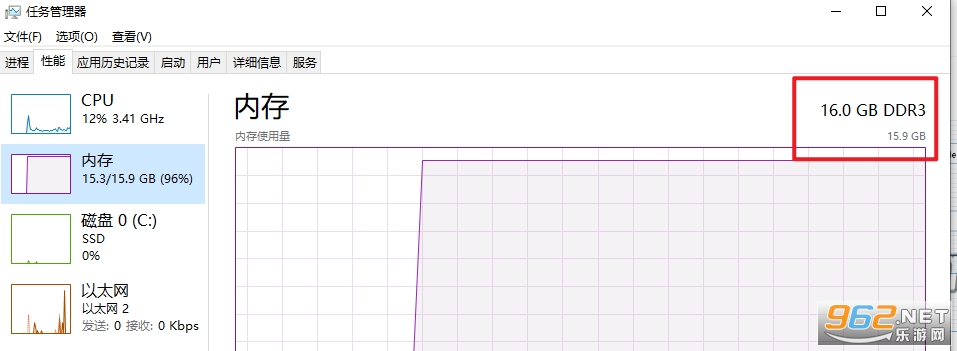

������������ĵĹؼ��㣺���Կ������ڴ桢��Ӳ�̡���CPU����������Ҫ���ǿ��Կ���

�Կ�N����Ӣΰ��Nvida�Կ���A���ò��ˣ������10ϵ���Դ����4G��6G�����ϲ��ⶥ���ڴ����8G��16G�����ϲ��ⶥ��Ӳ�̿��ÿռ�����и�500G���ϣ���̬��ѣ���еӲ��Ҳû������⡣CPU��ʵû̫��Ҫ���к��Կ��ģ�CPUһ�㲻��ܲ

��ο��Լ��ĵ����Կ���

����������������� - GPU �����ɿ����Դ档ֻҪ����4G��������һ�档�ұ��и��������ڣ����һ��������汾�����ڶ��У�ֻҪ��̫Զ�ž��У����µ����¸��á�

��ο��Լ��ĵ����ڴ棿

���������������������ڴ棬���ϽǼ��ɿ����ڴ�������

������װ�̳�

������������Ǹ���Դ��ַ��װ��û�Ӵ���������ˣ��û�һ����ʱ����ܸ㶨������һ�����㶼�㲻����

��ҪдС������ְ��ֽ̳ɣ��Ҹо��÷ֺü�ƪ���£�Python��װ��Git��װ���Կ����������Լ�CUDA��webui.........😂😂ֱ��Ȱ�ˡ�

�����д�������һ�����������ڵ���Ҷ�������A1111������Ľ����˰�װ�ż�����ƪ�����̳̣�������ʹ��һ�����������֣��������鵽SD����Ȥ��һ��������ֻ�Ƿ�װ�˿��ӻ���һ�����棬����Ӱ���ͼЧ������ֻ��ʡȥ�˱��ز�����ż���

����ʹ����Ҷ���� (bilibili:���~aaaki) ��һ����������

https://pan.baidu.com/s/1qWggi0qMMTdMpqCNCRcjoQ?pwd=a241

ת���ֹʧЧ��

https://pan.baidu.com/s/1_oY7lqRqWn330yEjIIhTxg?pwd=6666

�ٷ���̳���۵�ַ��

https://support.qq.com/product/488228

01

���غ��ѹ

02

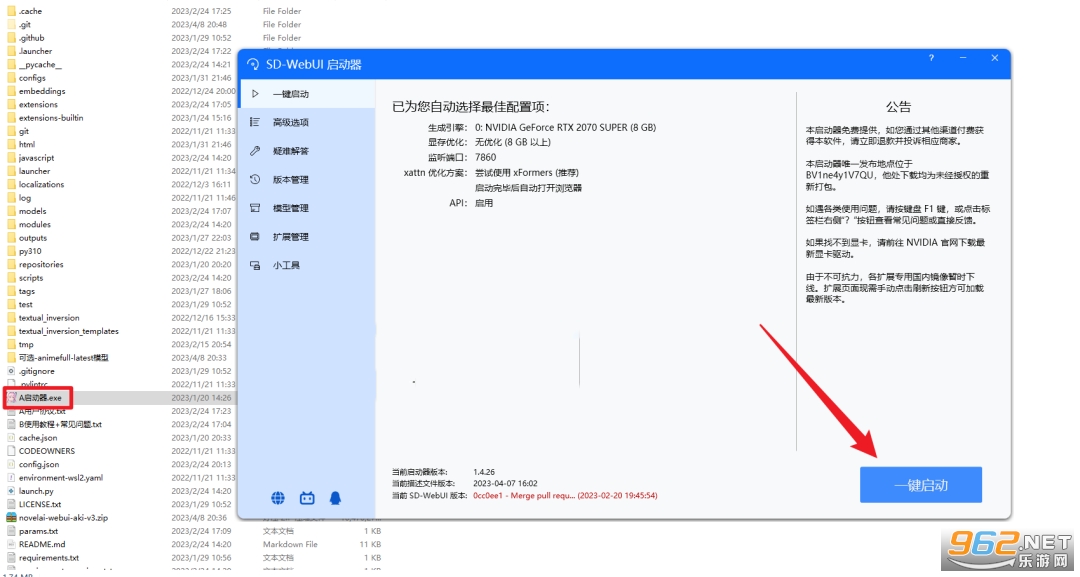

��������������һ������

03

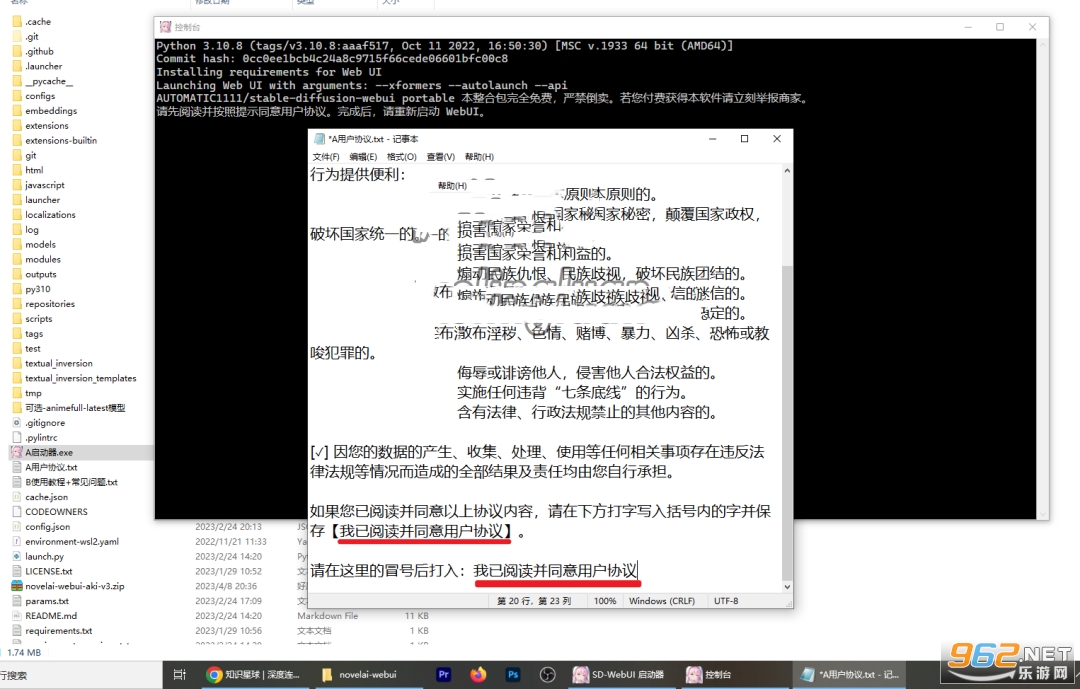

�״�����������txt�ı�������Ҫ����ճ�� �����Ķ���ͬ���û�Э�� ������txt

����һ������

04

�����ɹ���������ô��😂😂

05

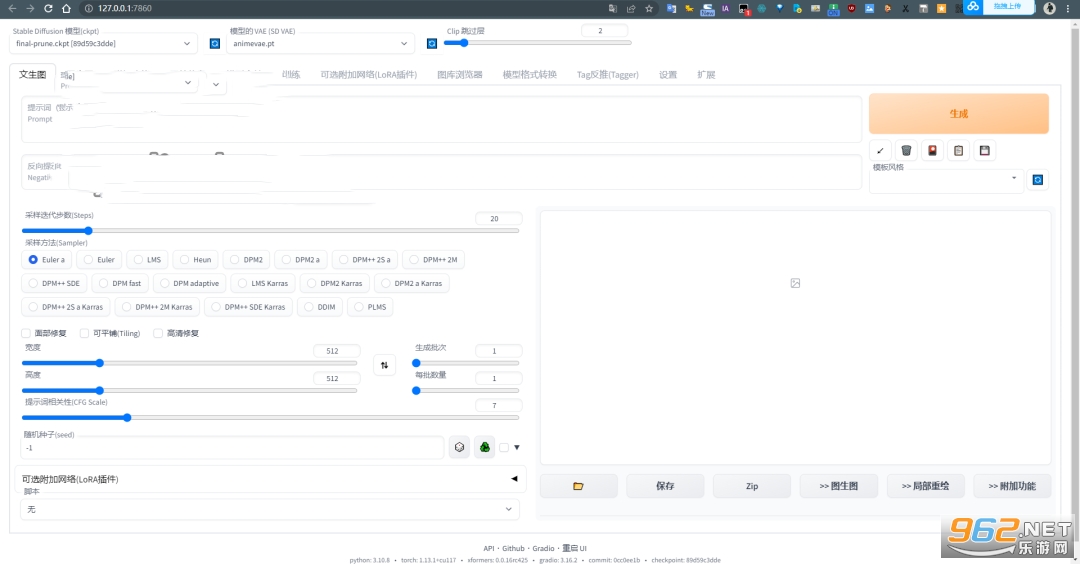

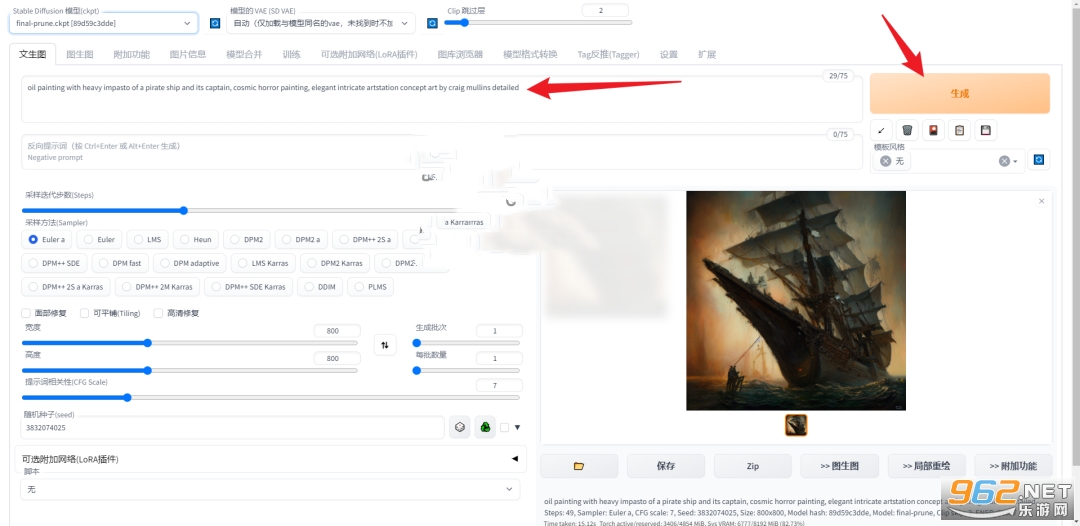

С��ţ��һ�£���ҿ���������һ��ָ�Ȼ�������ɣ����½Ǽ��ɳ�ͼ������Ч����

oil painting with heavy impasto of a pirate ship and its captain, cosmic horror painting, elegant intricate artstation concept art by craig mullins detailed

�ġ���װģ��

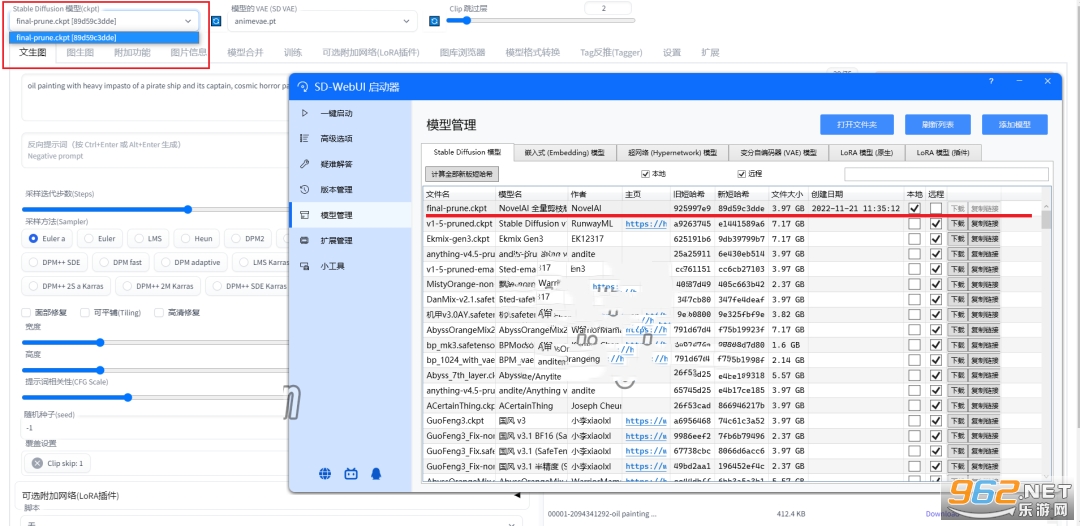

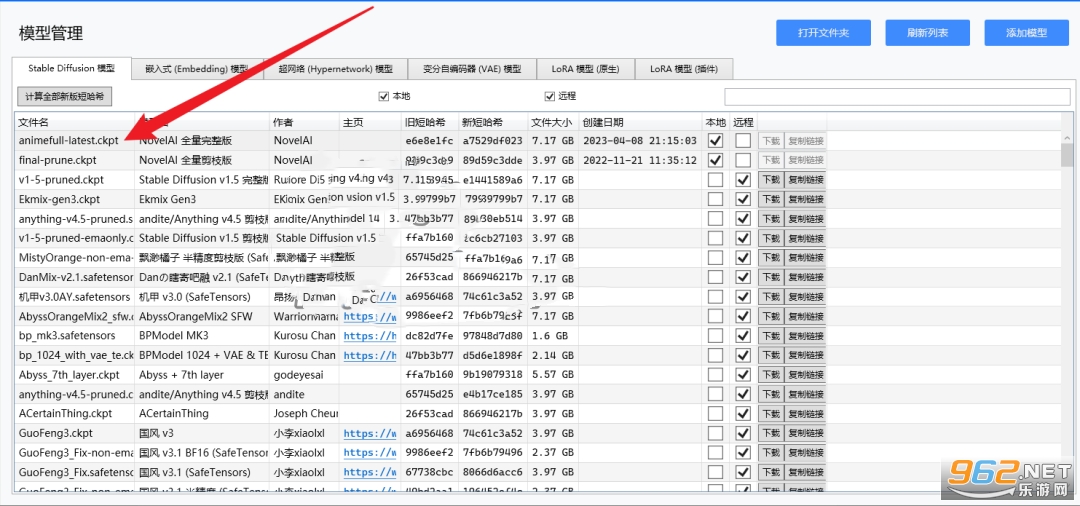

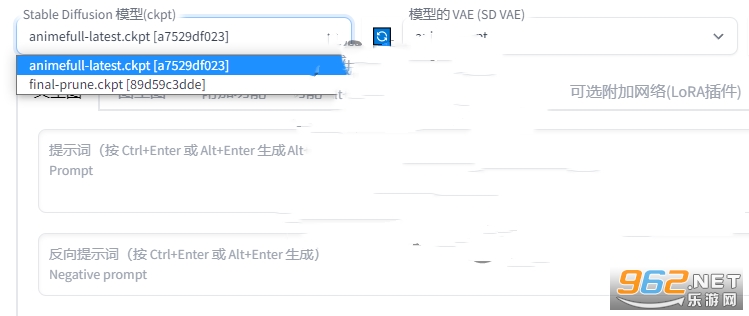

Ĭ��ֻ��һ��ģ�ͣ���������ģ����ҳ����Կ��������ش�������ʹ�ã�������ģ����Ҫ���ز���ʹ�á�������webuiҲ���Կ�����ֻ����һ��ģ�Ϳ�ѡ��

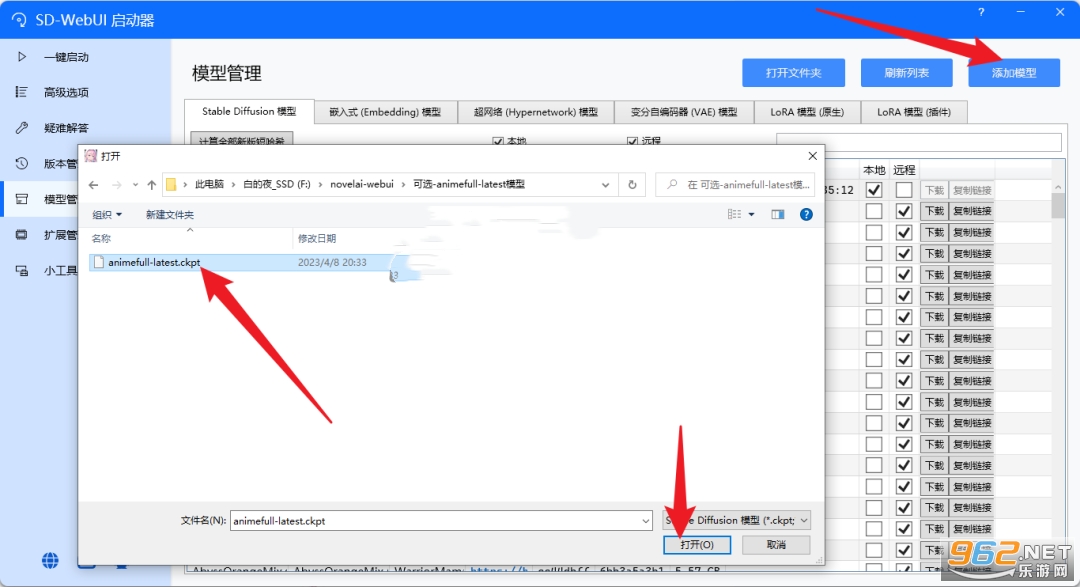

��ε����أ������ذ�װ����ʱ���������һ�� ��ѡ-animefull-latestģ�ͣ������Ϊ������ʾ�µ���ģ��

01

�����Ͻ�����ģ�ͣ��ڵ������ļ���������ѡ��ģ�ͣ���Ϊ .ckpt ,�����

02

�ɹ�����

03

�رտ���̨����������webui�Ϳ��Կ��������ӵ�ģ����

stable diffusion2.2���ز�������Ҫ�� stable diffusion a����װ��

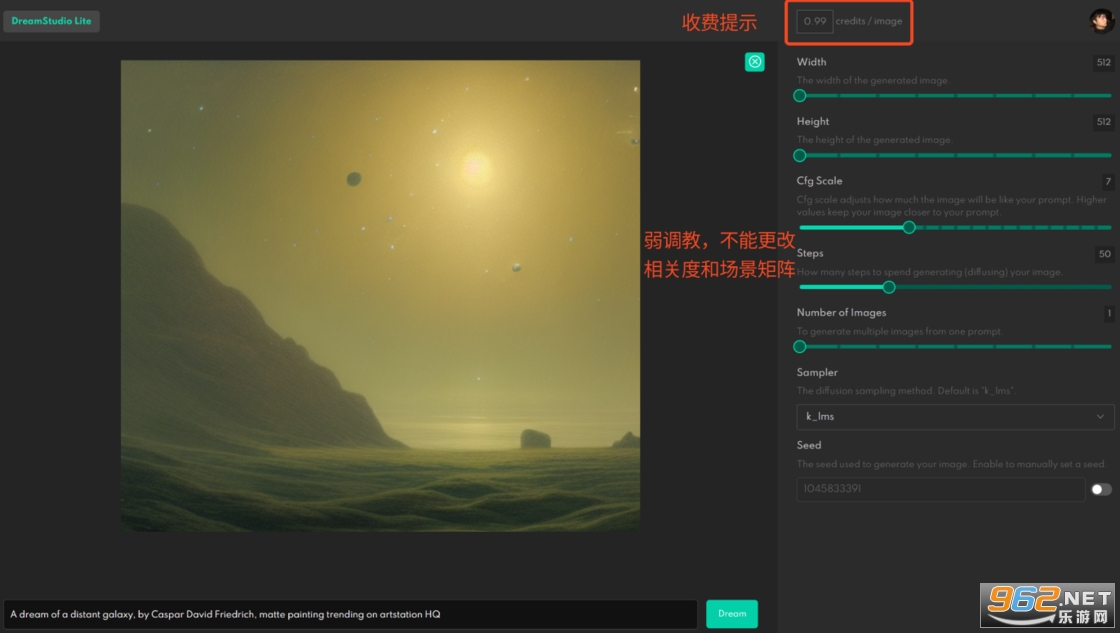

Stable Diffusion �����ı�����ͼ��� AI ���ߣ�Ҳ��Ψһһ���ܲ����ڼ��õ����ϵ� AI ��ͼ���ߣ������� RTX 2060 �Կ��� 6GB �Դ棨�����ϣ��Կ������У����ڼ�����������ͼ������Ԥ�����ͺ�������Ȼ�����ֻ�������� Stable Diffusion��Ҳ����ʹ�����߹��� Hugging Face �� DreamStudio���뱾�ز�����ȣ�Hugging Face ���Ŷӣ�����һ��ͼԼ 5 ���ӣ�DreamStudio ��������� 200 ��ͼƬ��֮����Ҫ�ɷѡ�����Ҫ���ǣ��������߹��߶�ͼƬ�ĵ��̹���ƫ��������������ͼƬ��ֻ�����ڲ������顣

����������ʹ�ã���������һ����ʹ�� Docker Desktop �� Stable Diffusion WebUI Docker ������ Windows ϵͳ���Ӷ����õ����Կ����ʵ�� AI ���ֻ滭�����ٱ����߹��������ơ�Mac ͬ�������ڸ÷���������ʡ���·��Ļ������ò��衣

stable diffusion ��ʾ���б�

����һ��ͨ�õ�ָ�ϣ������ǻ���ͨ�õģ���������������������Ӧ���½��˽ⲻͬӦ�õ����ԡ�

��ʾ������ʾ�������ж����ݣ����������������ж��ʻ��ʱ����ʵ�����������ݵķ�Χ�������� ��Ҫ�� AI ��һ�źܺõ�ͼƬ��

���ʱ�ǩ#

�����ڱ�ǩ�������ػ�ѵ����ģ�ͣ�����ʹ�ö��Ÿ����ĵ�����Ϊ��ʾ�ʡ�

��ͨ�����ĵ��ʣ������ǿ��������ݼ���Դվ���ҵ���������ǩ������ Danbooru)�����ʵķ��Ҫ��ͼ�����������䣬�������ֻ��ӵķ�����㡣

�������ƴд����NLP ģ�Ϳ��ܽ�ƴд����ĵ��ʲ��Ϊ��ĸ������

��Ȼ����#

��������Ȼ�������ػ�ѵ����ģ�ͣ�����ʹ����������ľ�����Ϊ��ʾ�ʡ�

ȡ����ѵ��ʱʹ�õ����ݼ�������ʹ��Ӣ�ģ����ģ�������Ż�һЩ���ġ�����������Ӣ�Ľ�Ϊ��Ч��

���� with ֮������Ӵʻ��ӵ�������������� NLP ģ��ֻ�������Ĵ�����

����ʹ������������ �� �� �����͵��� umlauts���� ä �� ö�������ǿ�������ӳ�䵽��ȷ�������С�

���������������ֳ�ģ�壬���������������������ģ�塣

Emoji#

Emoji (💰,💶,💷,💴,💵,🎊,🪅🪄,🎀,👩🚀) �������Ҳ�ǿ���ʹ�ò��� �dz�ȷ �ġ�

Emoji ��Ϊֻ��һ���ַ�������������ȷ���ϱ������á�

Emoji �ڹ�ͼ����Ӱ�죬���� 💐☺️💐��

������Ųο�

������#

����ʹ�� Danbooru ���ݵ�ģ����˵������ʹ����������һ���̶��Ͽ��Ƴ�ͼ�ı��顣

���磺

:-) Ц :-( ���� ;-) ʹ��ɫ :-D ���� :-P ����ͷ :-C �ܱ��� :-O ���� �Ŵ�� :-/ ����

��֧�����������֣���ϸ������� Danbooru �����ֲ��� �� ά���ٿ�

�ո�#

����ǰ��������ո�Ӱ��ʵ��Ч����

��ͷ�ͽ�β�Ķ���ո�ᱻֱ�Ӷ����������֮��Ķ���ո�Ҳ�ᱻ������

������#

�ö��š���š������ǿ��ַ���\0�����ָ��ؼ��ʣ��������ͼ��������Ŀǰ��������������͵ı����Ż��������Ч����á���������ʱ��ֻҪ��һ��ʹ��ʾ�����ױ��Ķ��ķ�ʽ������

���ڲ���ģ�ͣ����齫�»��ߣ�_��ת��Ϊ�ո�

��������#

����ͨ��ָ�����ؼ���������������Ч��ָ�������ͼƬ��

��ʾ�ʳ���# ��ʾ�ʷ����˳��������ȼ���������ʾ�ʵ�Ȩ��ֵ��ǰ���ݼ����������ر����ʾ���Ѿ���ͼƬ��ʵ������Ӱ������

���ѵ���ʾ����һ����ϰ�ߣ����������ȷʵ�кܶ�����Ҫд�������ʵ�������ɲ������Ա������ɹ����и��õ�������ʾ�ʡ�

SD-WebUI ͻ����� 75 ���������Ƶķ�ʽ�ǽ�ÿ 20 + 55 ���ʷ�Ϊһ�顣ѡ�� Increase coherency by padding from the last comma within n tokens when using more than 75 tokens �ó�����ͼͨ��������� N ��������Ƿ������һ�������������������������У������о����ö��ŵ�����һ���ƶ�����һ�������С��ò��Կ��ʵ�������ʾ�ʹ��������������⣬�������ƻ���ʾ��֮���Ȩ�ع�ϵ��

���� WebUI �Դ����������������⣬���� GPT-3 ģ�����ƣ���ʾ�ʴ����ռ䲢�������ģ�������� 75-80 ֮�䣬75 �ַ�������ݻᱻ�ضϡ�

������#

��������������ƫ���ϡ������������ѵ����˵����������������Ҫ����������֮�����ϵԽǿ���������Խ����ѧϰ������ϵ��

���仰˵�����һ���ؼ����зdz�����ĺ��壬��ôѧϰ����ͼ��֮�����ϵҪ��һ���ؼ����зdz��㷺�ĺ������öࡣ

����һ������ʹ���� ��Zettai Ryouiki�� ��������ʹ�õĹؼ���Ҳ�ܲ����dz��õĽ������Ϊ��ֻ�ڷdz�����������ʹ�á���һ���棬�������� ��ʹ��һ���Ƚϳ����Ĵʣ�Ҳ��������ܺõĽ�������������Ϊ�����������ͬ���������ʹ��û��������˼�Ķ������������������ͼƬ�����ݣ�ѡ�����Ĺؼ���������Ҫ�����⣺��Ĵ��Խ������Խ�á�������ܵĻ����������½��Ϳռ�Ĵ�ǣ�����Ҫ �����⣬ ������ͼ��Ķ����������� ���� �� ��С�� �����ĸ���Ҳ��������ģ���Ϊ�������������������Զ�������ֵġ���������£�ʹ���кܴ�������ֳ���������Ҫ��ͼ������ϵĴ�ǡ�

����ʧ��#

ÿһ����ʾ�ʾ���Ⱦ��һ�������ǵ� �����ԡ� ��ͬ���������������ʾ�ʣ����� loli (��������ʾ�ʲ��з���)��Ӱ��ʹ���������ʾ�ʡ� ���磬����������ɶ���ͼƬ��ʹ���� �ǿ� startrail ��ǩ��������������ֵĶ����ǿգ����и���������ʵ��Ƭ���ǿ�Ԫ�ء�

����ʾ��#

SD-WebUI ��ҳӦ�û�������ʱ �������ɷ���ʾ���ἰ�����ݡ�

����ʾ��һ��ʹ�� Stable-Diffusion �ķ�ʽ�������û�ָ�������뿴�������ݣ�������ģ�ͱ����������Ҫ��

ͨ��ָ�� unconditional_conditioning �������������в�������鿴ȥ��������ʾ��ͼ�DZ�����ȥ����������ϸ�����ʾ��ͼ����״����״��֮��IJ��죬�����Խ����ս��Զ�����ʾ�ʡ�

����ʹ��������ʾ�ʱ�������ˮӡ���������ݣ�

lowres, bad anatomy, bad hands, text, error, missing fingers,

extra digit, fewer digits, cropped, worst quality, low quality,

normal quality, jpeg artifacts, signature, watermark, username, blurry ����������ӣ�

ugly, fat, obese, chubby, (((deformed))), [blurry], bad anatomy,

disfigured, poorly drawn face, mutation, mutated, (extra_limb),

(ugly), (poorly drawn hands fingers), messy drawing, morbid,

mutilated, tranny, trans, trannsexual, [out of frame], (bad proportions),

(poorly drawn body), (poorly drawn legs), worst quality, low quality,

normal quality, text, censored, gown, latex, pencil